Ausgabe 04/2023

Kurzmeldungen Digitalisierung

ver.di fördert digitale Teilhabe

Um digitale Teilhabe nicht nur zu fordern, sondern auch zu fördern und aktiv zu bewerben organisiert ver.di IT-Netzwerkkonferenzen, bei denen Betriebs- und Personalräte zu Digitalisierungsthemen, wie jüngst zu KI, zusammenkommen um betriebliche Regelungen, wie moderne und innovative Tarifverträge, Betriebs- und Dienstvereinbarungen, die Beschäftigung fördern, erarbeiten. In einem daraus entstandenen Digitalisierungsnetzwerk im ver.di-Mitgliedernetz tauschen sich mehrere hundert Aktive über Termine, Branchenanalysen und Materialien sowie vor allem betriebliche Gestaltungsmöglichkeiten aus.

KI macht Sorgen

Umfrage I – Seit Einführung im November 2022 hat fast jede*r Vierte ChatGPT bereits für berufliche oder private Zwecke genutzt. ChatGPT steht für "Chatbot Generative Pre-trained Transformer". Mit ihm können Benutzer*innen über Texteingaben mit dem Computer kommunizieren, ähnlich einem Chat. Besonders daran ist, dass der Chat-Bot aus der Unterhaltung lernt. Anwendungen mit sogenannter generativer (erzeugender) Künstlicher Intelligenz (KI) wie ChatGPT verbreiten sich rasant und verursachen erhebliche Sorgen in der Bevölkerung. Das hat eine repräsentative Forsa-Umfrage im Auftrag des TÜV-Verbands ergeben. 80 Prozent der Befragten stimmen der Aussage zu, dass beim Einsatz von KI derzeit nicht abschätzbare Risiken bestehen. 65 Prozent befürchten, dass die Technologie für Menschen nicht mehr beherrschbar ist oder dass sie ohne ihr Wissen manipuliert werden könnten (61 Prozent). 76 Prozent haben Bedenken, dass KI persönliche Daten nicht ausreichend schützt. Große Sorgen bereiten der Bevölkerung die Auswirkungen von generativen KI-Anwendungen auf Medien und Politik. Jede*r Zweite sieht durch die Technologie die Demokratie in Gefahr. 84 Prozent der Befragten gehen davon aus, dass KI die Verbreitung von "Fake News" massiv beschleunigen wird. 91 Prozent glauben, dass kaum noch erkennbar sein wird, ob Fotos oder Videos echt oder gefälscht sind. 91 Prozent fordern deshalb, dass der Gesetzgeber einen rechtlichen Rahmen für den sicheren Einsatz von KI schafft. Aktuell ist eine KI-Verordnung in der EU geplant.

KI bedroht Sicherheit

Umfrage II – Gut jedes zehnte Unternehmen in Deutschland war im vergangenen Jahr von einem IT-Sicherheitsvorfall betroffen (11 Prozent). Dabei handelt es sich um erfolgreiche Cyberangriffe oder andere sicherheitsrelevante Vorfälle wie Sabotageakte oder Hardware-Diebstahl. Das hat eine repräsentative Ipsos-Umfrage im Auftrag des TÜV-Verbands unter 501 Unternehmen ab 10 Mitarbeitenden ergeben. Sowohl weltpolitische Spannungen als auch technologische Trends wie die Verbreitung Künstlicher Intelligenz seien eine Gefahr für die Cybersicherheit der Unternehmen in Deutschland. Neben kriminellen Hackern verstärkten staatliche Akteure ihre Aktivitäten, um an sensible Daten zu gelangen, Geld zu erpressen oder Unternehmen zu sabotieren. Die größte Gefahr geht aus Sicht der befragten Unternehmen von der organisierten Cyberkriminalität aus: 57 Prozent fühlen sich von organisierten Hacker-Banden bedroht. Jeweils 27 Prozent sehen staatlich organisierte Wirtschaftsspionage oder politisch motivierte Akteure als große Gefahr. 22 Prozent fürchten sogenannte Innentäter*innen, die über interne Kenntnisse eines Unternehmens verfügen und diese bei einem Angriff ausnutzen können. Angesichts der Bedrohungslage spricht sich eine Mehrheit für zusätzliche gesetzliche Vorgaben aus.

KI braucht Regeln

Gesetz – Noch im Juni soll der sogenannte Artificial Intelligence Act der EU final abgestimmt werden. Der "AI Act" wird das weltweit erste Gesetz, das "Künstliche Intelligenz" umfassend reguliert. Dabei geht es nicht nur um Dienste wie ChatGPT, sondern auch um Kameras am Bahnhof, die verdächtige Bewegungsmuster erfassen sollen, oder um die Software, mit der eine Personalabteilung Bewerbungen sortiert. Die Verordnung legt Mindestanforderungen fest, die KI-Systeme erfüllen müssen, um sicher, transparent, zuverlässig und verantwortungsbewusst zu sein. KI-Technologien werden nach ihrem Risikoniveau eingestuft – von minimal über begrenzt und hoch bis inakzeptabel. Daran werden verschiedene Compliance- und Informationspflichten gekoppelt. Technologien mit einem "unannehmbarem Risiko" wie Social Scoring sollen komplett verboten werden. "Hochrisiko-KI-Systeme", die "ein hohes Risiko für die Gesundheit und Sicherheit oder für die Grundrechte natürlicher Personen darstellen" sollen nur betrieben werden dürfen, wenn unter anderem eine durchgehende Risikoanalyse dokumentiert wird, eine Aufzeichnung von KI-Vorgängen während des Betriebs stattfindet und eine Beaufsichtigung durch Menschen gewährleistet wird. Zu "Hochrisiko-KI-Systemen" gehören zum Beispiel Biometrische Identifizierungs- und Klassifizierungssysteme, kritische Infrastruktur wie Verkehrs- und Energiesysteme oder solche, die in der Strafverfolgung und Justiz verwendet werden. Für KI-Systeme, die ein "geringes" oder "minimales Risiko" aufweisen, will die EU Transparenzpflichten verankern, wenn Anwendungen mit Menschen interagieren, eingesetzt werden, um Emotionen zu erkennen oder Inhalte zu erzeugen oder diese zu manipulieren ("Deepfakes"). In diesen Fällen muss gewährleistet werden, dass Nutzer über den KI-Einsatz oder -Ursprung Bescheid wissen. Die EU-Verordnung weise zahlreiche Leerstellen auf, kritisiert netzpolitik.org, die ausgerechnet beim KI-Einsatz durch staatliche Behörden und das Militär besonders groß ausfallen.

KI und Literatur

Forschung – Drei freiberufliche Übersetzer*innen und ver.di-Mitglieder haben das Projekt "Kollektive Intelligenz – Übersetzungsmaschinen und Literatur" gegründet, um gemeinsam mit 14 Kolleg*innen die Auswirkungen von Künstlicher Intelligenz auf die Arbeit der Literaturübersetzung zu untersuchen. Mit dem Projekt – gefördert vom Deutschen Übersetzerfonds im Rahmen des Programms "Neustart Kultur" – wird die Anwendbarkeit der KI-Anwendung "DeepL Translator" in der literarischen Übersetzung untersucht. Die Projekt-Website kollektive-intelligenz.de wird über die Ergebnisse der Experimente informieren und vertiefendes Hintergrundwissen zum Thema bereitstellen.

Und der Negativpreis geht an...

Big Brother Awards – Seit dem Jahr 2000 werden in Deutschland die BigBrotherAwards an Firmen, Organisationen und Personen verliehen, die in besonderer Weise und nachhaltig die Privatsphäre von Menschen beeinträchtigen sowie persönliche Daten verkaufen oder gegen ursprüngliche Interessen verwenden. Auch in diesem Jahr wurde der Negativpreis für die Feinde des Datenschutzes in fünf Kategorien verliehen.

In der Kategorie "Behörden und Verwaltung" ging der Preis an das Bundesfinanzministerium. Mit dem Preis wird das seit dem 1. Januar 2023 geltende Plattformen-Steuertransparenzgesetz (PStTG) bedacht. Dieses Gesetz soll im Bereich der Plattformökonomie für Steuergerechtigkeit sorgen und hatte ursprünglich gewerbliche Portale wie airbnb oder Uber im Fokus. Darüber hinaus zwingt es Plattformanbieter aber auch zur umfassenden Vorratsdatenspeicherung über private "Flohmarktverkäufe".

In der Kategorie "Finanzen" erhielt das Fintech-Unternehmen finleap dafür, dass es über Jahre hinweg fälschlicherweise Informationen zum Kontowechsel an Firmen schickt, die mit dem Vorgang nichts zu tun haben. Dabei geraten Namen, Geburtsdaten und neue Kontonummern von Betroffenen in falsche Hände. Hinweise darauf ignoriert die Firma.

In der Kategorie "Kommunikation" ging der Negativpreis an Zoom Video Communications Inc., die als US-Unternehmen Daten an Geheimdienste weiterleiten müssen, aber dennoch behaupten, Datenschutz-konform zu sein. Zoom untersteht überdies chinesischer Kontrolle und Zensur, da relevante Teile der Entwicklung in China stattfinden. Der Preis geht auch an alle Gruppen, insbesondere Menschenrechts- sowie Umwelt- und Klimaorganisationen, die Zoom einsetzen und damit ihre Teilnehmer*innen der Überwachung preisgeben, obwohl es freie und datenschutzfreundliche Alternativen gibt.

In der Kategorie "Verbraucherschutz" erhielt die Deutsche Post DHL Group den BigBrotherAward 2023 für praktizierten Digitalzwang. Sie will Kund*innen durch die Umstellung in ihren Packstationen dazu zwingen, ein Smart- phone und die Post & DHL-App zu nutzen. Die App sendet ungefragt Daten an Tracking-Firmen. Dieser Digitalzwang gehört besonders gerügt, denn hier schließt ein ehemaliges Staatsunternehmen Bürger*innen von einer wichtigen Grundversorgung aus.

Für sein "Lebenswerk" wurde Microsoft bereits zum zweiten Mal ausgezeichnet (zuerst im Jahr 2002) – dafür, dass es mit seiner Marktmacht Menschen, Unternehmen und Behörden zwingt, bei deren digitalen Aktivitäten dauernd Daten in die USA zu übermitteln und sich dadurch in Echtzeit überwachbar zu machen.

Durch moralische Abgründe

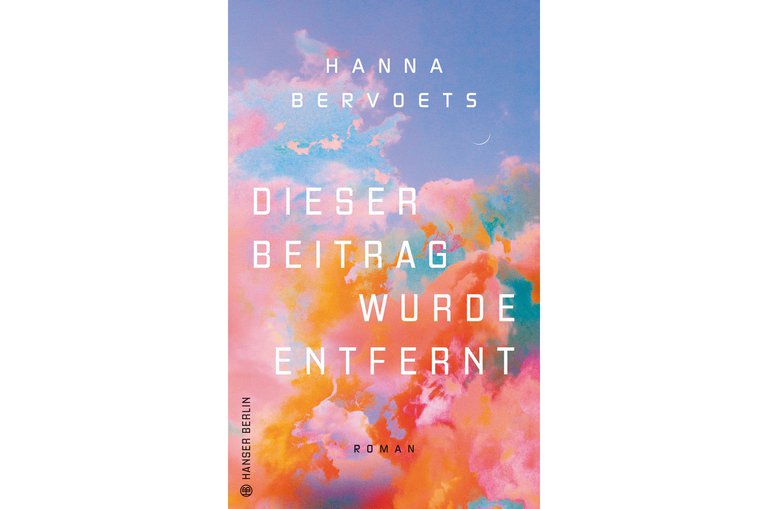

Buchtipp – Hanna Bervoets' Roman nimmt uns mit auf eine beunruhigende Reise in die toxische Arbeitswelt der Content Moderator*innen. Die niederländische Erfolgsautorin lässt ihre Protagonistin vermeintlich unbeeindruckt durch die moralischen Abgründe der digitalen Welt wankeln – während ihre Kolleg*innen verstört und traumatisiert langsam durchdrehen. Ein psychologisch komplexer Kurzroman – zu gleichen Teilen aufwühlend, faszinierend und schockierend.

Hanna Bervoets, "Dieser Beitrag wurde entfernt", aus dem Niederländischen von Rainer Kersten, Hanser, Erscheinungsdatum: 25.7.2022, ISBN 978-3-446-27379-5, 112 S., 20 €